می خواهیم یک شبکه عصبی ساده بسازیم که بتواند اشیاء ( یا هرچیزی ) را کلاسه بندی ( دسته بندی ) کند، به آن داده ورودی بدهیم، آن را آموزش دهیم و انتظار خروجی مناسب داشته باشیم. وقتی بحث کلاسه بندی مطرح باشد، پیاده سازی در هردو مورد انسان ها، هوش مصنوعی و یادگیری ماشین مدنظر خواهد بود.

مقاله مرتبط :

کلاسه بندی ( Classification )

خب کلاسه بندی چیست و چه فایده ای دارد؟

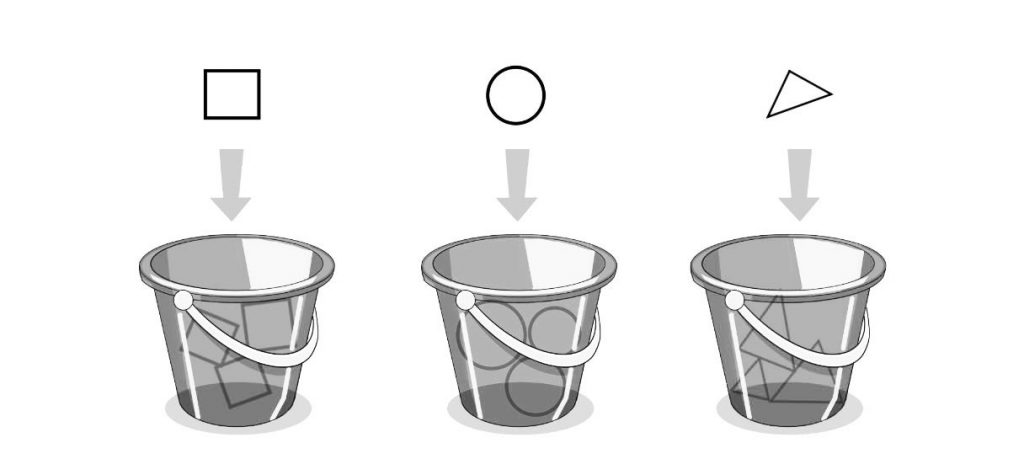

کلاسه بندی می تواند به عنوان گروه بندی اشیاء بوسیله ویژگی ها، خصیصه ها و پارامترهای کیفی به اشتراک گذاشته شده تعریف شود، یا صرفاً انداختن اشیاء درون سبدهای مرتبط با آن ها، که به عنوان نمونه می توان به کلاسه بندی شکل های هندسی زیر براساس نسبت تشابه آن ها اشاره کرد.

کلاسه بندی در طبیعت نقش بسیار مهمی را ایفا می کند و به عنوان چالشی برای ارگانیزم و امری حیاتی برای بقا و تولید مثل، مطرح است.

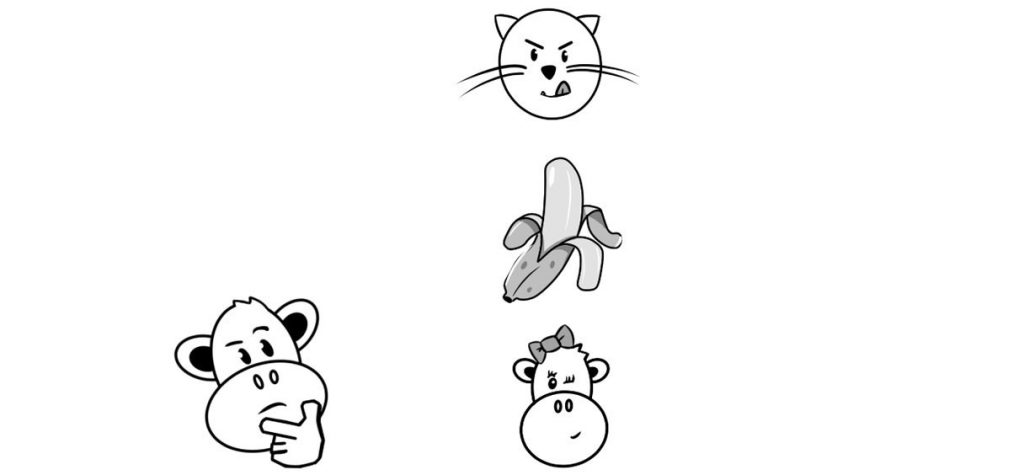

به عنوان نمونه، یک میمون را در ساوانا در نظر بگیرید که لازم است بداند کدام یک از اشیاء یک تهدید، کدام یک وعده غذایی و کدام یک جفت احتمالی برایش محسوب می شود:

پس زمینه زیست شناختی

در ابتدایی ترین سطح این مسئله کلاسه بندی، بحث توانایی مجزا کردن دو یا تعداد بیشتری شئ از یکدیگر با استفاده از هیچ چیزی بجز عصب ها، ارتباطات و ترتیب آن ها، می باشد.

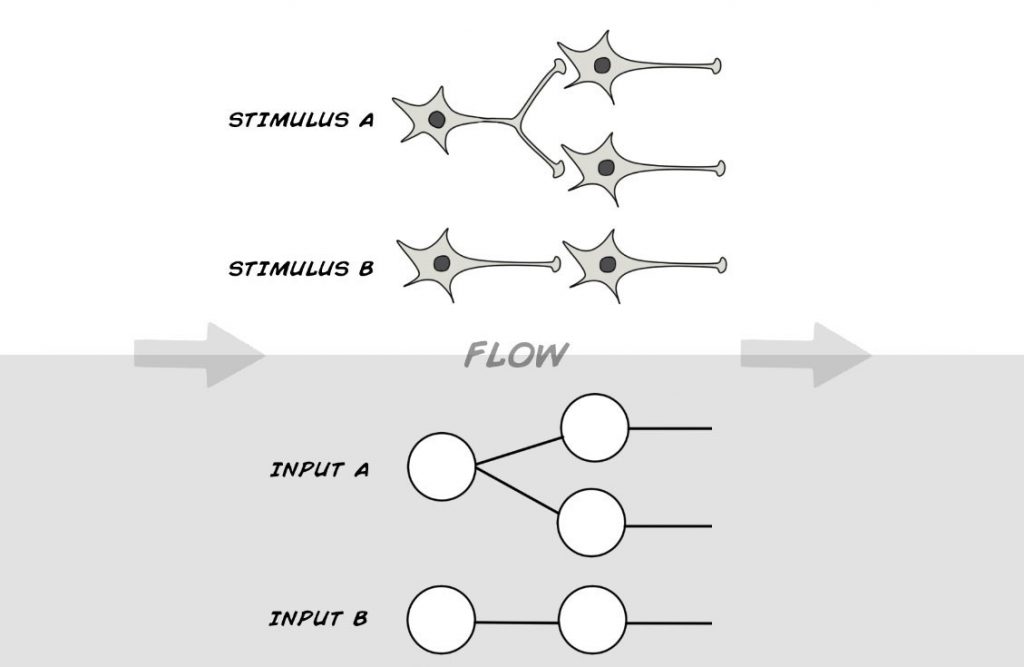

یک ترتیب موازی محرک روبه جلو از عصب ها ( که در بخش اول این مقاله به آن اشاره کرده بودیم )، شماتیک و گرافی مانند مدل زیر خواهد داشت:

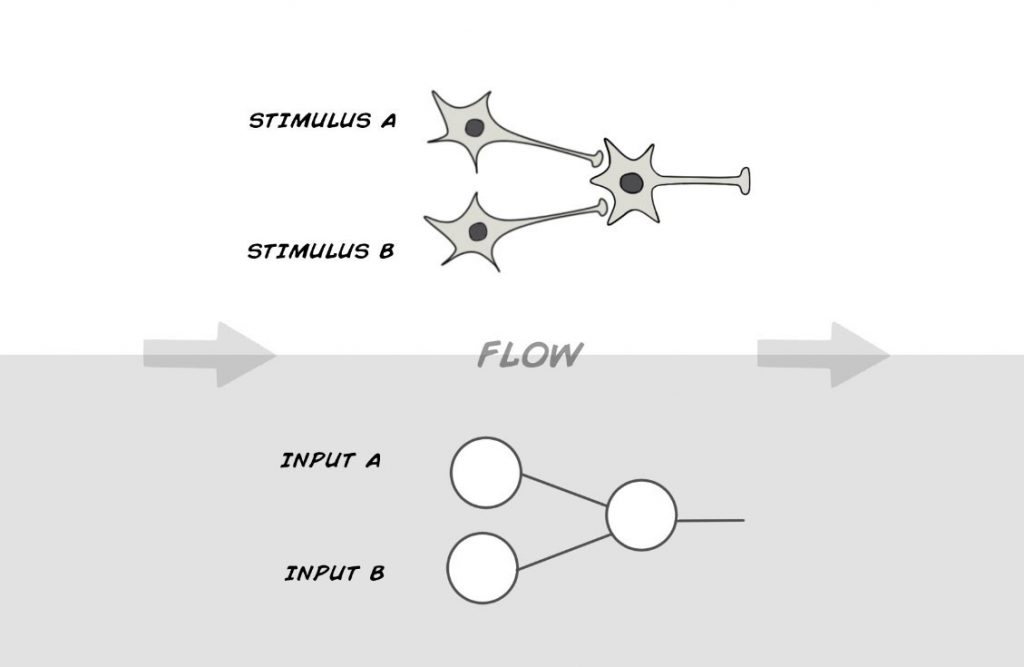

در چنین ترتیبی، محرک های عصبی A و B هیچ اصلاعاتی را به اشتراک نمی گذارند و مستقل می مانند، بنابراین هیچ راهی برای عصب های سطح بالا تر به منظور مقایسه و کلاسه بندی، وجود ندارد; به نظر می رسد که طبیعت این مشکل را صرفاً بوسیله ترکیب ورودی ها، برطرف کرده است:

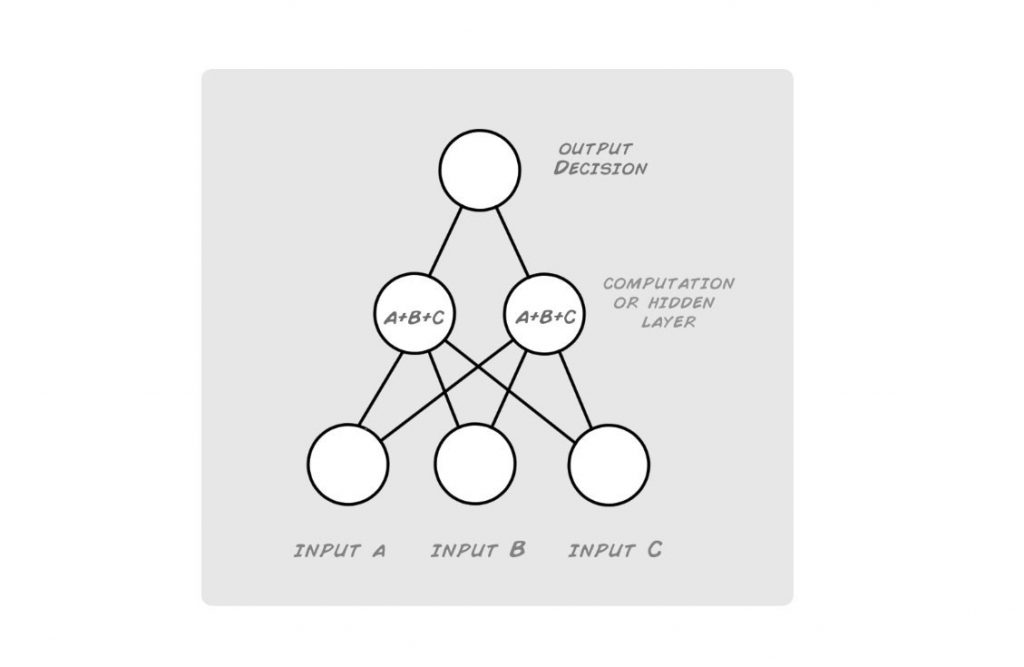

این ترتیب از عصب ها، اجازه می دهد تا محاسبات و رفتارهای جدید خود را نشان دهند: حال یک عصب سطح بالا تر یا یک نود، می تواند براساس ترکیبی از ورودی ها فعالیت کند:

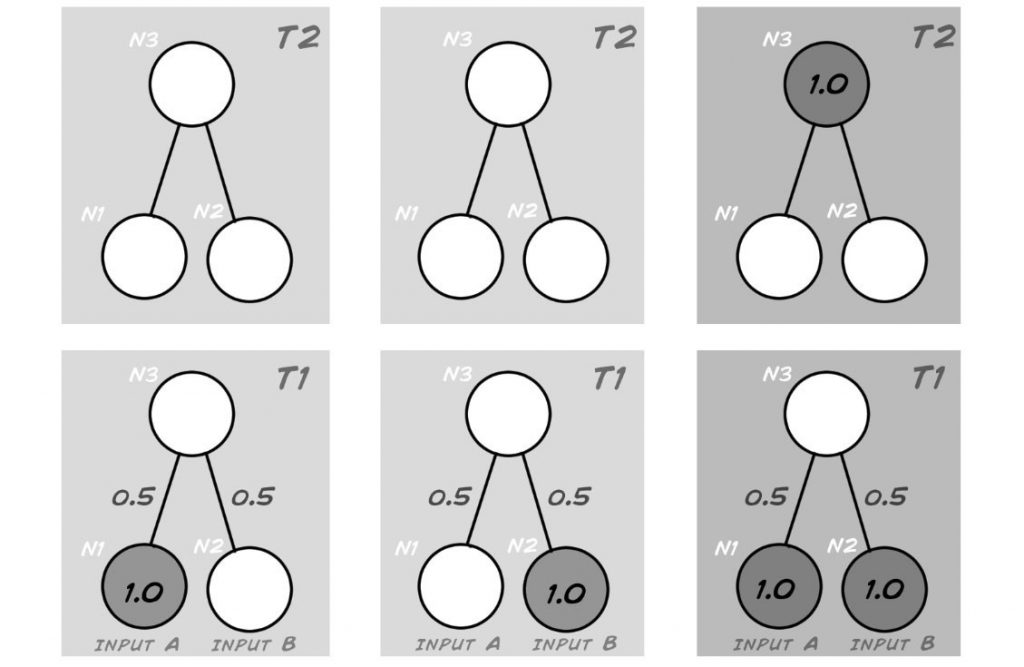

به عنوان توضیحی برای باقی مانده ای از گرافی که ما در حال استفاده از آن هستیم می توان گفت، در مثال بالا ۳ عصب برچسب گذاری شده N1 تا N3 وجود دارد، عصب های فعال بوسیله یک پس زمینه تیره و عدد ۱٫۰، علامت گذاری شده اند; وزن های بین عصب ها بیرون از اتصال ها قرارداده شده است(۰٫۵) و زمان بر اساس حرکت از پایین به بالا و با T1 و T2 نمایش داده شده است. در این شبکه عصبی خاص که در حال حاضر آموزش داده شده است، عصب ۳ فعال نخواهد شد تا زمانی که هر دو ورودی A و B باهم و همزمان فعال شوند. فعال سازی عصب ۳ از طریق ضرب ورودی ها در وزن ها، حاصل می شود. (۱ × ۰٫۵ + ۱ × ۰٫۵ = ۱)، این عصب صرفاً در صورتی فعال می شود که جمع ورودی هایش برابر ۱ باشد، بنابراین می توان گفت که آن یک آستانه فعال سازی به میزان ۱ دارد. کلیت ترتیب عصب ها معمولاً یک پرسپترون ( شبکه ای از عصب ها که وظیفه شناسایی الگوها را دارند) نامیده می شود.

به منظور مواجهه با تصمیم های به مراتب پیچیده تر، به نظر می رسد که مغز باید این ترتیب را بوسیله اضافه کردن لایه های بهم متصل میانی بیشتری، توسعه دهد. نتیجه این محاسبات جدید، عمومیت دادن و ترتیبی جدید است که به عنوان نمایش توزیع شده نامیده می شود ( بر خلاف نمایش اجزای گسسته ):

عمومیت دادن ( Generalization ):

در جهان هستی موارد زیادی وجود دارد که تداعی کننده ای برای هر دو مدل ماشین ها و مغزها در قالب کد و پاسخ، باشد. بنابرای عمومیت دادن امری مطرح در این زمینه است و معنای آن در شبکه عصبی این است که ورودی هایی با ماهیتی مشابه، پاسخ های یکسان یا مشابه ای را براساس ارتباطاتشان ایجاد می کنند.

نمایش توزیع شده ( Distributed Representation ):

داشتن یک عصب تنها که صرفاً یک محرک یا ورودی را نمایش می دهد نمی تواند کافی باشد و عصب ها و اتصالات زیادی برای ساخت یک شبکه نیاز است، بنابراین یک ترتیبی که در آن تعداد کمی از عصب ها چندین ورودی را نمایش می دهد، مدلی است که مغز در موارد زیادی از آن استفاده می کند، یک نمایش توزیع شده.

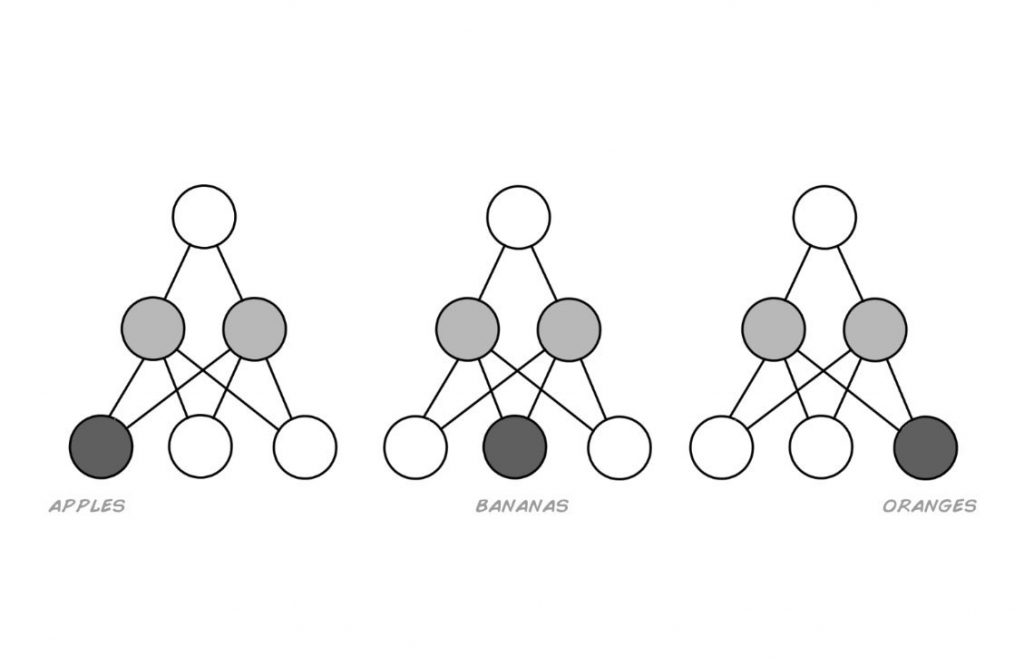

در مدل بالا، لایه میانی شمال ۲ عصب است و یک نمایش توزیع شده از مواد غذایی میوه ای ( fruity food ) می باشد که سه نوع خاص از ورودی ها ( سیب ها، موزها، پرتقال ها ) را به ۲ مورد کلی ( مواد غذایی میوه ای موجود ) و یک لایه تصمیم نهایی رمزنگاری می کند که می تواند به این صورت باشد: اگر اینجا مواد غذایی میوه ای وجود دارد، بخورید.

تا زمانی که این مثال خاص ( مواد غذایی میوه ای ) در مغز شما وجود داشته باشد، یک نمایش توزیع شده به همراه قسمت های اصلی یا درواقع بلاک های سازنده آن، احتمالاً بهتر قابل درک خواهد بود:

اختصاصی بودن ( Specificity ):

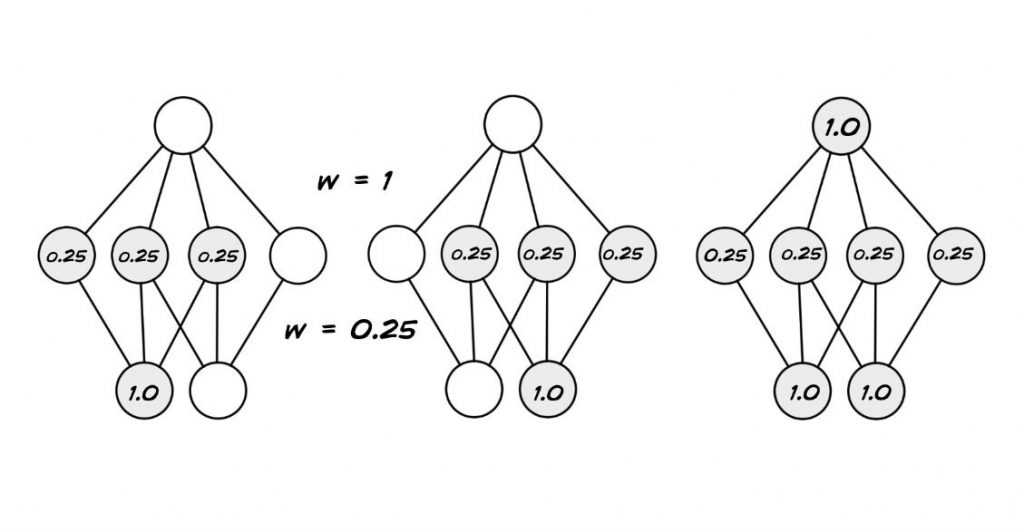

اگر یک توزیع تعمیم یافته از شبکه عصبی نتواند بین ورودی ها تمایز ایجاد کند، قابلیت استفاده زیادی نخواهد داشت، اختصاصی بودن از طریق وزن های بین عصب ها حاصل می شود، وزن هایی که از طریق آموزش تنظیم شده اند.

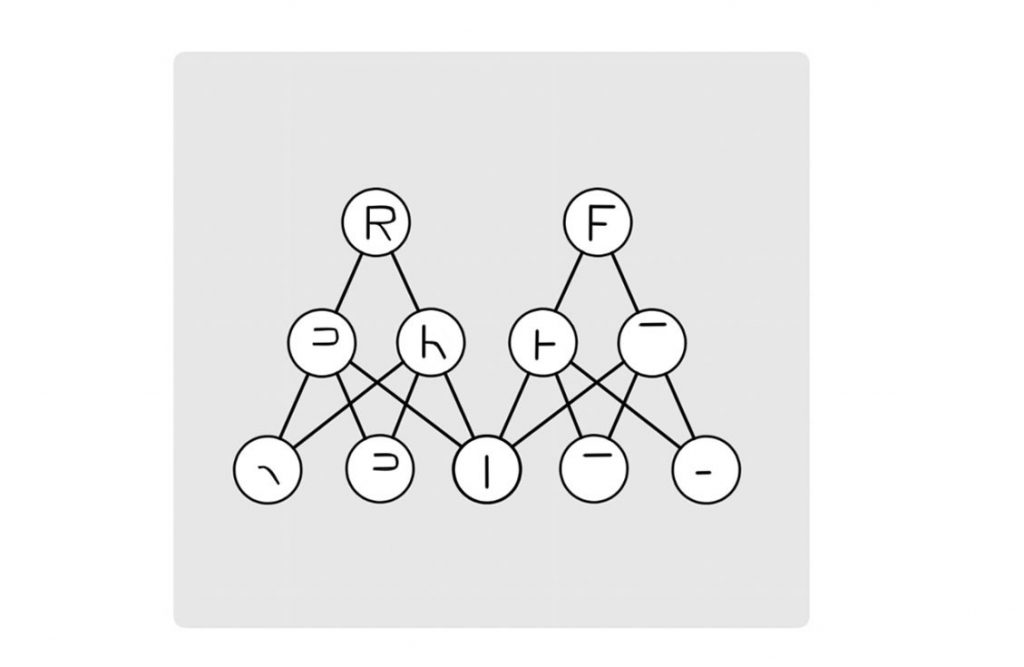

این شبکه عصبی به منظور فعال سازی نود تصمیم ( بالاترین نود ) فقط در زمانی که هر دوی ورودی ها حاضر باشند، آموزش داده شده است. وزن های تمام ارتباطات ثابت نگه داشته شده است و زمان نیز به منظور ساده سازی مدل، فشرده و خلاصه شده است. با توجه به اینکه لایه میانی در مثال مدنظر تقریباً بی استفاده است، یک شبکه ساده تر مانند اولین مدلی که مطرح کرده بودیم، می تواند عملکردی مشابه داشته باشد. مزیت داشتن لایه میانی یا پنهانی صرفاً زمانی مشخص می شود که کلاس های بیشتری اضافه کنید:

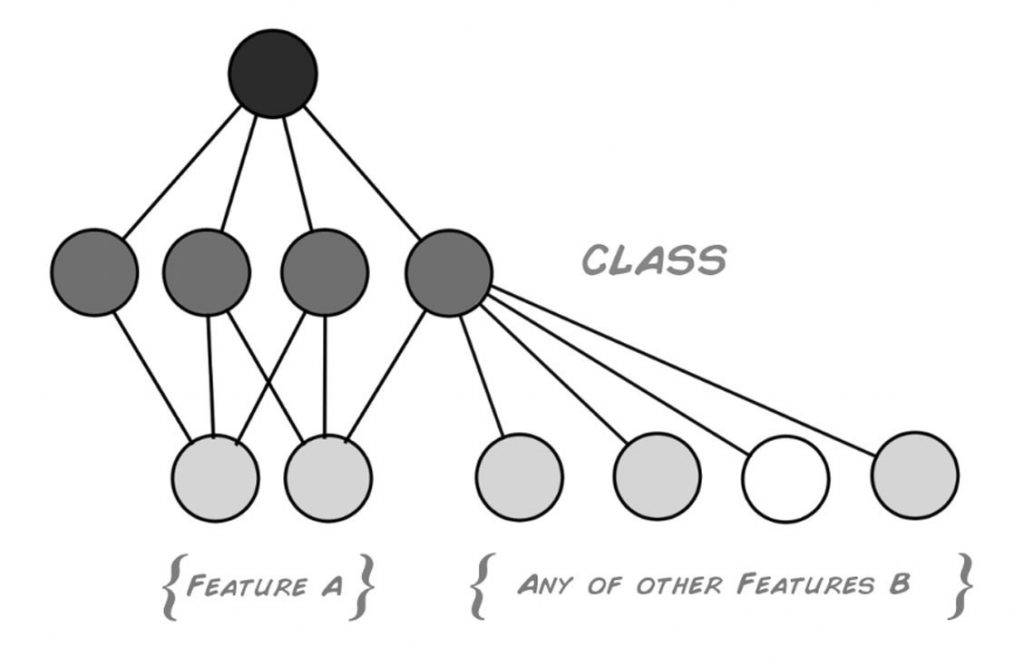

این معماری جدید شبکه اجازه دسترسی به بسیاری از رفتارهای جدید را صرفاً با تعداد اندکی نودهای اضافه، فراهم می کند. براساس چگونگی در نظر گرفتن وزن ها، این شبکه می تواند عمل شناسایی را انجام دهد یا بر پایه ترکیبی از مجموعه ویژگی A و مجموعه ویژگی B، تصمیمی را اتخاذ کند.

محاسبات بیشتر:

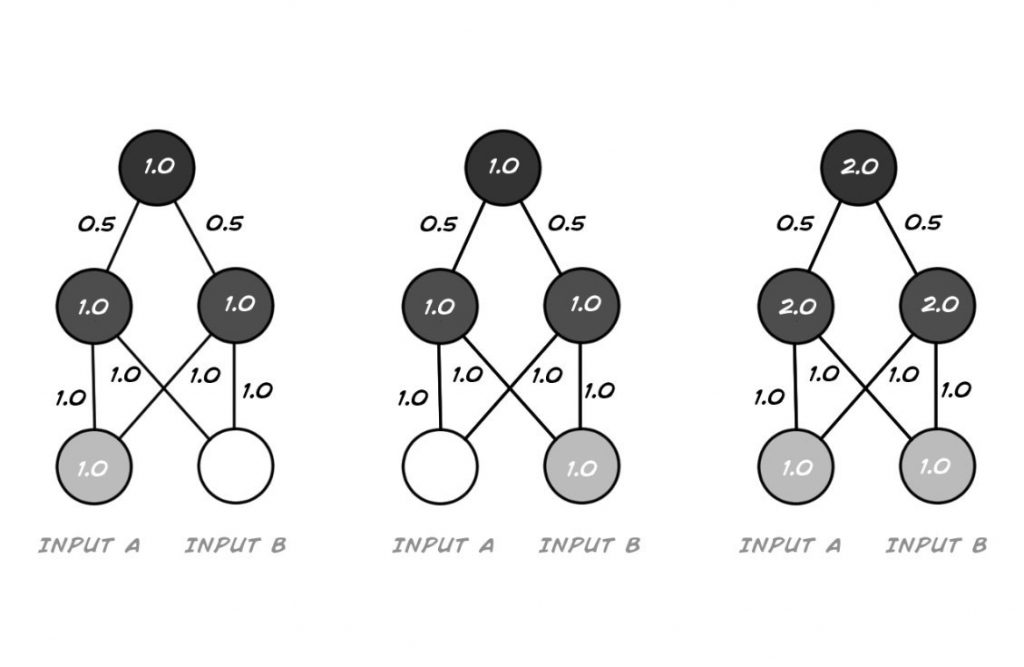

تاکنون درحال استفاده از چیزی بودیم که می توانیم آن را به عنوان نوعی نود Or( لایه میانی یا پنهان ) در نظر بگیریم، که راهی برای شناسایی یک یا چندین فعالیت ورودی است و پس از آن یک پاسخ و خروجی مهیا می کند که به این صورت می باشد:

نودهای or در صورتی پاسخ فراهم می کنند که ورودی A، ورودی B یا هردو فعال باشند، اما ۲ حالت ممکن دیگر که ما نیاز به شناسایی داشته باشیم، وجود دارد:

1) فراهم کردن پاسخ در صورتی که ورودی A یا ورودی B حاضر باشند اما نه زمانی که هر دو حاضر هستند.

2) فراهم کردن پاسخ فقط در صورتی که هر دوی ورودی ها حاضر باشند.

به منظور بر طرف کردن این مشکل، نوعی جدید از نود ( نود پیکربندی شده – Configural Node ) مطرح می شود که بیانگر عملگر مورد نیاز XOR( عملگر Or انحصاری ) است:

یک نود اضافی در امتداد وزن ها برای ساخت موردی خاص و یک پاسخ منفی، استفاده شده است ( این مسئله به عنوان الگوبندی منفی نامیده می شود ). درحالی که شبکه دوم که فقط در صورت حاضر بودن هر دو ورودی فعال می باشد، می تواند به این صورت ساخته شود، ترتیبی ساده تر نیز می توان استفاده کرد.

بیشتر بخوانید :

- فناوری تشخیص پلاک خودرو چگونه جامعه را هوشمندتر می کند

- گوگل ساختار سازمانی خود را جهت تمرکز بر هوش مصنوعی اصلاح می کند

- پلاک خوان های شهر گرینزبوروی آمریکا فعلاً قرار نیست افزایش پیدا کنند

- فرماندار اوکلند از پلاک خوان ها حمایت می کند اما مخالفان در اثربخشی آن تردید دارند

- لبنان استفاده از پلاک خوان های خودکار را تایید کرد

مجله هوش مصنوعی شهاب

مجله هوش مصنوعی شهاب