مقالات زیادی در مورد خاموش کردن ربات های فیسبوک، پس از توسعه زبان مخصوص خودشان منتشر شده است . رسانه ها تنها عناوینی که مخاطبان را جذب می کنند را دوست دارند . برخی از این مقالات به شما می گویند که این اتفاق یک فاجعه قریب الوقوع بوده است. که دانشمندان فیسبوک قبل از اینکه این هوش مصنوعی ها بتوانند جهان را در دست بگیرند آن را خاموش کردند . خوشبختانه هنوز هم افراد عاقل در آنجا وجود دارند. بنابراین تعدادی مقاله در دسترس است که نشان می دهد چرا تمام صحبت های روز قیامت در این مورد به طور کامل پوچ است (مانند موارد منتشر شده در Snopes یا CNBC) حتّی برخی از رسانه هایی که یک نسخه بسیار شرم آور از این رویداد را ارائه کرده بودند، سرانجام محتوای آن را ویرایش کردند تا کمتر منفی جلوه داده شود (مانند این مثال از The Independent )

مشکل این است که خبرهای دروغین اما جذاب بسیار ساده تر از هر چیز دیگری پخش می شوند.همچنین برای من جالب بود که هیچ یک از مقالات واقعاً توضیح نداده اند که چه اتفاقی افتاده است تا مردم بدانند. سعی کردم اوضاع را برای برخی از دوستانم توضیح دهم و در نهایت به این نتیجه رسیدم که ارزش نوشتن را دارد ، شاید این امر به افراد در خوابیدن بدون فکر کردن به SKYNET (هوش مصنوعی فیلم Terminator که جهان را تسخیر کرد) کمک کند. با این حال، هدف من این است که نشان دهم چگونه این به اصطلاح هوش مصنوعی، کار می کند – بدون موضع گیری.

تحقیقات هوش مصنوعی فیسبوک (FAIR)

اما فیسبوک واقعاً چه کاری انجام می داد؟ و چگونه ربات ها “تقریباً دارای ادراک شدند”؟ کل این پروژه به خوبی مستند شده و برای عموم در دسترس است. هر کسی می تواند این هوش مصنوعی را دانلود و اجرا کند، همچنین زبان جدید خود را مشاهده کند. فقط لطفاً مراقب باشید و به موقع آن را خاموش کنید همانطور که مهندسان فیسبوک انجام می دادند.

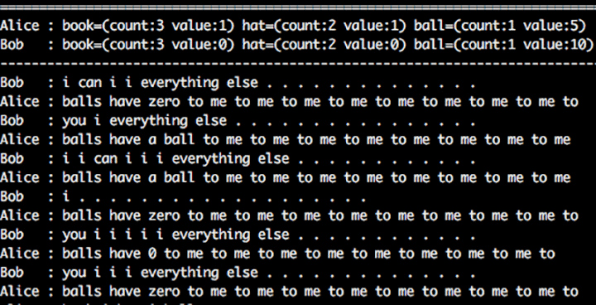

سیستم سعی می کند گفتگو و مذاکره را شبیه سازی کند. به اصطلاح مجموعه ای از آیتم ها (شامل کتاب ، کلاه و توپ) و برخی ترجیحات برای این که کدام اقلام بیشتر از بقیه خواستنی تر هستند. سپس قرار است با طرف مقابل خود مذاکره کند ، یک انسان یا ربات دیگری باشد ، در مورد چگونگی تقسیم کردن گنج در میان خودشان .

این تحقیق در ماه ژوئن منتشر شد، که شامل کلیه داده ها و کدهای آموزشی که برای آزمایش استفاده شده است، می باشد . اگر بیشتر به جزئیات علاقه مند هستید ، مقاله رسمی را بخوانید یا فقط کد مربوط به آن را از Github دریافت کنید.

پس به زبان ساده این کار چگونه انجام می شود؟

یادگیری ماشین

من شما را با همه جزئیات فنی به زحمت نخواهم انداخت، اما درک برخی از اصول اولیه در مورد اینکه این تکنولوژی چگونه کار می کند ، مهم است.

هنگام توسعه یک ربات ، شما با چیزی به نام “مجموعه داده آموزشی” شروع خواهید کرد . این شامل نمونه های خوبی از رفتارهایی است که ربات در تلاش برای شبیه سازی آن می باشد. در این مورد خاص ربات مذاکره در فیسبوک ، شما نمونه هایی از گفتگوهای مذاکره را با ذکر تمام شرایط عنوان می کنید – وضعیت اولیه چگونه بود، ترجیحات مذاکره کننده چیست، چه گفته شد، نتیجه چه بود و غیره. این برنامه تمام مثال ها را تجزیه و تحلیل می کند، برخی از ویژگی های هر گفتگو را استخراج می کند، و اعدادی را به این ویژگی ها اختصاص می دهد، در واقع نشان م یدهد که چند بار گفتگو با آن ویژگی نتیجه مثبت برای مذاکره کننده به پایان رسیده است. بهتر است تصور کنید که یک “ویژگی” چیست ، کلمات ، عبارات و جملات را در نظر بگیرید. در واقعیت بسیار پیچیده تر از این است، اما برای رسیدن به اصل موضوع به اندازه کافی خوب است.

برای اینکه دقیق تر باشیم، اگر ربات کلاه ها را می خواهد، عبارت “شما می توانید همه کلاه ها را داشته باشید” نمره بسیار پایینی دارد چون این جمله با نتیجه بد در هر سناریو از داده های آموزشی به پایان می رسد؛ مذاکره کننده چیزی که می خواست را به دست نمی آورد.

این اساساً نسخه صفر از هوش مصنوعی شما خواهد بود. اکنون می داند که کدام جملات بیشتر از مذاکره سود می برند. می توانید از آن برای شروع گفتگو استفاده کنید ، سعی خواهد کرد بر اساس تعداد جمع آوری شده در مرحله تمرینی ، احتمال نتیجه مثبت را به حداکثر برساند. اصطلاح هوش مصنوعی در اینجا عجیب و غریب است – خیلی مصنوعی است ، اما خیلی هوشمند نیست. معنی آنچه را می گوید درک نمی کند. در واقع یک مجموعه بسیار محدود از دیالوگ ها برای ارتباط با آن وجود دارد، و فقط برخی از کلمات یا عبارات را بر اساس احتمالات محاسبه شده از آن تاریخچه ی گفتگوها دریافت می کند. هیچ کار دیگری نمی تواند بکند. تنها احتمال رسیدن به مقدار مورد نظر کلاه ها ، توپ یا کتاب را محاسبه می کند و بر اساس آن چیزی را روی صفحه می نویسد.

مرحله بعدی استفاده از تکنیکی به نام یادگیری تقویتی است. از آنجایی که توانایی ما برای ارائه داده های آموزشی با کیفیت خوب نسبتاً محدود است ، ما به یک روش دیگری برای این هوش مصنوعی نیاز داریم . یکی از روش های معمول این است که اجازه دهید هوش مصنوعی یک شبیه سازی را اجرا کند و نتایج آن را یاد بگیرد. قبل از اینکه توضیح دهم که این موضوع برای مذاکره در مورد ربات به چه معنی است ، اجازه دهید از یک هوش مصنوعی مثالی بزنم.

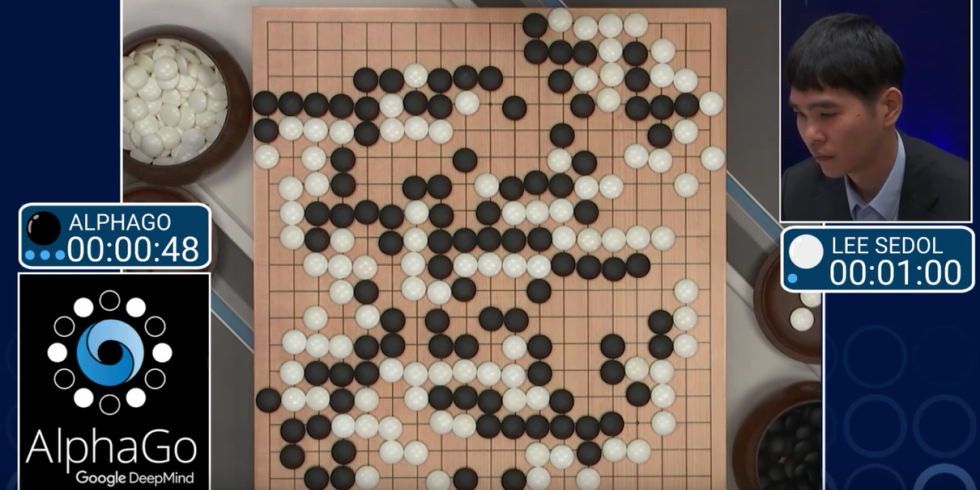

AIphaGo

Deepmind AIphaGo گوگل، برنامه ای است که ممکن است در مورد آن در سال گذشته شنیده باشید . این اولین هوش مصنوعی بود که یک بازیکن حرفه ای Go را شکست داد . و در واقع این نمونه کاملی از یادگیری تقویتی در عمل است.

AIphaGo شروع به یادگیری از بازی های واقعی کرد که توسط افراد حقیقی بازی می شد، تجزیه و تحلیل و امتیاز دهی هر حرکت ممکن است بر اساس این دانش انجام شود. AIphaGo به تنهایی قادر به انجام بازی نبود؛ اگر چه بسیار ضعیف بود و این بازی را درک نمی کرد، اما راهی برای امتیاز حرکات بر اساس بازی های قبلی تحلیل شده داشت.

اما شبیه سازی Go بسیار آسان است . ما مجموعه ای دقیق از قوانین داریم و هدف بسیار خوبی برای پیروزی در این بازی داریم. پس فقط می توانیم دو مورد از این هوش مصنوعی را ایجاد کنیم و اجازه دهیم تا علیه خودش بازی کند. از آنجایی که ما قدرت محاسباتی زیادی داریم، می توانیم به راحتی میلیون ها بازی را برای آموزش و پرورش خیلی از بیشتر از هر انسانی انجام دهیم. سپس احتمالات پیروزی برای هر حرکت براساس تمام نتایج شبیه سازی شده به روز رسانی می کند، و در به ثمر رساندن حرکات بهتر و موفق تر می شود.

دوباره، من این مفهوم را ساده می کنم. اگر می خواهید در مورد AIphaGo بیشتر بدانید، من می توانم این مقاله را از کریستوفر برگر پیشنهاد کنم . فقط می خواهم یک چیز را از این مثال متوجه شوید. اگر ما بتوانیم سه شرط را برآورده کنیم، یادگیری تقویتی واقعاً خوب است (به همان اندازه که توسط AIphaGo و بسیاری از افراد ثابت شده است)

۱- یک فضای مشخص از گزینه ها برای هوش مصنوعی . در مورد AIphaGo ، تنها می تواند حرکت معتبر Go انجام دهد.

۲- یک راه خوب برای کسب نتیجه. در مورد فیسبوک، برد خوب است و ضرر بد است.

۳- یک روش خوب برای شبیه سازی وضعیت و اجازه یادگیری به هوش مصنوعی. در این حالت ، ما فقط می توانیم اجازه دهیم که هوش مصنوعی در برابر خودش بازی کند (ترجیحاً در برابر نسخه های مختلف خودش باشد زیرا یادگیری چیزی جدید اگر حریف شما متفاوت تر از شما بازی کند، راحت تر است.)

برگردیم به فیسبوک

پس بیایید نگاهی به موضوع اصلی بیاندازیم. فیسبوک تلاش می کرد تا رباتی بسازد که بتواند مذاکره کند. این سه شرط در بالا مناسب است؟ یک راه عالی برای کسب نتیجه وجود دارد زیرا یک مقدار اختصاص یافته به هر کالایی که بخشی از مذاکره است در دسترس است. ما یک روش خوب برای شبیه سازی شرایط داریم و اجازه می دهیم هوش مصنوعی یاد بگیرید. این دقیقاً همان کاری است که فیسبوک انجام داد؛ بگذارید دو نمونه از این ربات ها با یکدیگر مذاکره کنند. اما نکته آخر کمی مشکل ساز است.

برخلاف بازی Go، تعریف ساده ای از زبان انگلیسی وجود ندارد . مجموعه داده های اصلی آموزش به زبان انگلیسی بود، اما ویژگی های استخراج شده فقط کلمات و عبارات بودند و این ربات فقط آن ها را بر اساس بازنمایی عددی چگونگی قرار گرفتن در کمک به نتیجه، جمع می کرد.

دو ربات که در واقع زبان انگلیسی را درک نمی کنند، با یکدیگر صحبت می کنند و از یکدیگر می آموزند. تنها معیار موفقیت آن ها این بود که آن ها چطور کتاب ، کلاه و توپ را معامله می کردند. تنها قانون، پیروی کردن از کلمات روی صفحه بود. آن ها کم و بیش انگلیسی حرف می زدند اما از اشتباهات خودشان یاد می گرفتند، بدون اینکه بدانند این ها واقعاً خود اشتباه هستند؛ که منجبر به نتیجه مطلوب به شکل کلاه ، کتاب و توپ می شدند. برخی از کلمات از دست رفته اند چون طبق ارقام آن ها به نتیجه مذاکره کمک نمی کنند . بعضی از آن ها چند برابر شدند. اگر گفتن “من می خواهم” شانس بدست آوردن چیزی را بهبود ببخشد، پس چرا نباید آن را چندین بار بگوییم?

درست است؟ و زمانی که این کار انجام شو، هوش مصنوعی آن را تایید می کند که این یک استراتژی خوب است.

اگر در حال آموزش در برابر یک انسان بود، احتمالاً این مشکل بزرگی نخواهد بود چون طرف دیگر از زبان مناسب استفاده می کند . هر چند مشکل متفاوتی خواهد داشت. اجرای یک تعداد کافی از شبیه سازی ها در این روش برای آموزش هوش مصنوعی دشوار خواهد بود.

همانطور که مهندسان فیسبوک خاطر نشان کردند، اگر عملکرد امتیاز دهی نیز شامل بررسی زبان باشد، نسبت به این که ارزش کل موارد دریافت شده پس از مذاکره دریافت شود، نتیجه بهتری حاصل می شد. اما اینطور نبوداین واقعیت که زبان تخریب شده است به هیچ وجه شگفت انگیز و جالب نیست. این برای هر دانشمندی که روی این نوع مسائل کار می کند اتفاق می افتد، و من مطمئنم که مهندسین فیسبوک در واقع انتظار آن را داشتند. آن ها پس از چندین بار تکرار و پس از ناسازگاری های پیش آمده و عدم ارائه نتایج مفید، شبیه سازی را متوقف کردند.

به هر حال ، اگر گزارش یا مقاله منتشر شده را بخوانید، جدا از گفتگوی جنجالی که در تمام اینترنت به اشتراک گذاشته شده بود، در واقع نتایج بسیار خوبی نیز بدست آمده است. این آزمایش همانطور که در نظر گرفته شده عمل کرده است و من می گویم در کل بسیار موفق بوده.

این یک زبان “کارآمد تر” جدید نیست که فقط هوش مصنوعی می فهمد چون بعضی از روزنامه نگاران شما را به سمت اعتقاد سوق می دهند . این یک شکل منحصر به فرد از زبان انگلیسی است که پس از گذراندن دوره های زیادی از یادگیری تقویتی وجود دارد.

در پایان ، هیچ چیز عجیبی نیست!

هیچ چیز ترسناک ، تکان دهنده یا حتّی قابل توجه؛ اتفاق نیافتاده است. فقط یک روز منظم با یک آزمایش علمی منظم. و بعد مثل اینکه روزنامه نگارانی که یک مقاله روز قیامت را پس از دیگری پست کردند، جهنم به راه افتاد. خاموش کردن یک ربات چت هنگامی که نتایج معقول را نشان نمی دهد، به همان اندازه ی تغییر یک لامپ کم نور، بد است.

بیشتر بخوانید :

- هوش مصنوعی مولد تهدیدات جدیدی برای امنیت سایبری ایجاد می کند

- فناوری تشخیص پلاک خودرو چگونه جامعه را هوشمندتر می کند

- گوگل ساختار سازمانی خود را جهت تمرکز بر هوش مصنوعی اصلاح می کند

- پلاک خوان های شهر گرینزبوروی آمریکا فعلاً قرار نیست افزایش پیدا کنند

- فرماندار اوکلند از پلاک خوان ها حمایت می کند اما مخالفان در اثربخشی آن تردید دارند

مجله هوش مصنوعی شهاب

مجله هوش مصنوعی شهاب

سلام خیلی خوب و ساده توضیحدادید.

با اینکه قبول دارم این اتفاقی که افتاده ترسناک نبوده اما میتونه یه زنگ خطر باشه، البته به نظرم این زنگ خطر نباید ما را متوقف کنه ولی ما(انسان ها) باید حواسمون رو بیشتر جمع کنیم.

چون مثلا اگه یه ربات که با هوش مصنوعی کار میکنه رو طراحی کنیم و برد رو براش کمتر شدن گاز های گلخانه ای تعریف کنیم اون ممکنه برای رسیدن به برد آدم ها رو بکشه

و در واقع راه حل خیلی هم پیچبده نیست، کافیه حالاتی که برد اتفاق می افتند رو محدود تر کنیم مثلا در همین کاری که محققین فیسبوک انجام دادن باید برد رو علاه بر بیشترین میزان سود به دست آوردن نمره بالای ۹۰ از لحاظ درست بودن گرامر در نظر بگیرن

و در مثال من باید برد رو کم تر شدن گازهای گلخاته ای به شرط آسیب نرسیدن به انسان تعریف کنن

بله دقیقا

با افزودن شرط ها و پوشش دادن حالت های استثنایی که ممکنه پیش بیاد میشه از این جور موارد جلوگیری کرد

نمونه ی کامل تری از این مثالی که مطرح کردید توی فیلم I, Robot نشون داده شده. توصیه میکنم حتما ببینید. فیلم آموزنده و خیلی جالبیه

سلام،لینک Github رو میشه، درست کنید.

سلام

اصلاح شد.

واقعاً لذت میبرم از اینکه با نوابقی مثل شما عزیزان اشنا شدم اینجا

شما درست میگید احتمالا ابدارچی و نگهبان جلو مجتمع فیسبوک این ربات و طراحی کردن و فکرشون نرسیده به این نکات طلایی

اخه داداش گلم مکه دستور پخت قرمه سبزیه که نظر میدی خیر سرشون مهندسای یکی از قوی ترین سایتای پیامرسانن یعنی اندازه شما هم نمیدونن

این مواردی که گفته شده بر اساس گزارشات خود مهندسای پشت پرده این هوش مصنوعی بوده